|

|

| (86 dazwischenliegende Versionen von 2 Benutzern werden nicht angezeigt) |

| Zeile 4: |

Zeile 4: |

| '''Betreuer:''' [[Benutzer:Ulrich_Schneider| Prof. Schneider]]<br/> | | '''Betreuer:''' [[Benutzer:Ulrich_Schneider| Prof. Schneider]]<br/> |

| '''Art:''' Praxissemester<br> | | '''Art:''' Praxissemester<br> |

| '''Projektlaufzeit:''' 02.11.2021-20.02.2022 | | '''Projektlaufzeit:''' 02.11.2021 - 20.02.2022 |

|

| |

|

|

| |

|

| Zeile 12: |

Zeile 12: |

| == Einleitung == | | == Einleitung == |

|

| |

|

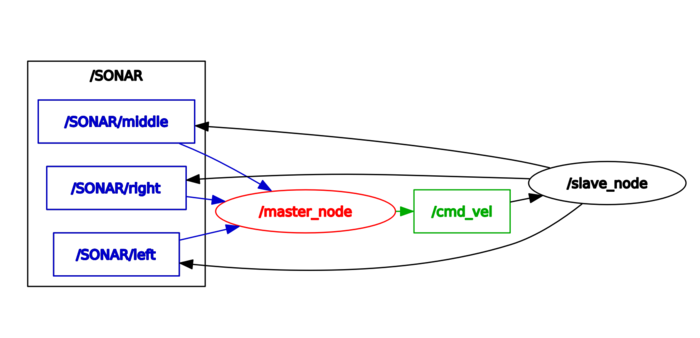

| Dieser Artikel beschreibt die Kommunikation von einem [https://de.wikipedia.org/wiki/Raspberry_Pi Raspberry Pi] mit dem [[Robot_Operating_System_2|Robot Operating System2 (ROS2)]](Abb. 1). Dazu wird erklärt, wie ein Raspberry Pi mit einem PC über SSH(Secure Shell) verbunden werden kann und wie der AlphaBot über den Raspberry Pi und ROS2 gesteuert wurde. Außerdem wird beschrieben was es für grafische Anzeige Möglichkeiten unter ROS2 gibt. | | Dieser Artikel beschreibt die Kommunikation von einem [https://de.wikipedia.org/wiki/Raspberry_Pi Raspberry Pi(RPi)] mit dem [[Robot_Operating_System_2|Robot Operating System2 (ROS2)]]. In Abb. 1 sind die Nodes master und slave zu sehen, welche auf der RPi ausgeführt werden. Über die Topics, wie cmd_vel oder die SONAR-Topics, kommunizieren die Nodes mit einander. Dazu wird erklärt, wie ein Raspberry Pi mit einem PC über [https://de.wikipedia.org/wiki/Secure_Shell Secure Shell (SSH)] verbunden werden kann und wie der AlphaBot über den RPi und ROS2 gesteuert wurde. Außerdem wird beschrieben was es für grafische Anzeige Möglichkeiten unter ROS2 gibt. |

|

| |

|

| == Übersicht == | | ==== Aufgabenstellung ==== |

| === Dokumentation === | | |

| | Das Ziel war es einen [[AlphaBot|AlphaBot]] mit ROS2 zu programmieren und fahren zu lassen, damit er Hindernisse mit Infrarotsensoren und dem Ultraschallsensor umfahren kann. |

| | |

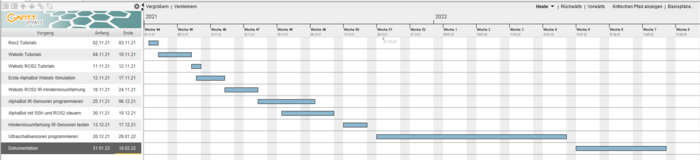

| | ==== Projektplanung ==== |

| | |

| | [[Datei:Projektplan_JonasGerken.png|left|mini|700px|Abb 2: Projektplan]] |

|

| |

|

| Zum beginn dieses Artikels werden die verschiedenen Anforderungen an das Projekt aufgezeigt(Tabelle 1/2).

| | <br clear=all> |

|

| |

|

| ==== Funktionale Anforderungen ==== | | ==== Funktionale Anforderungen ==== |

| Zeile 23: |

Zeile 28: |

| {| class="wikitable" | | {| class="wikitable" |

| |F1 | | |F1 |

| |Der Roboter muss Hindernisse mit Infrarotsensoren erkennen können. | | |Der AlphaBot muss Hindernisse mit Infrarotsensoren erkennen können. |

| |- | | |- |

| |F2 | | |F2 |

| |Der Roboter muss Hindernisse mit einem Ultraschallsensor erkennen können. | | |Der AlphaBot muss Hindernisse mit einem Ultraschallsensor erkennen können. |

| |- | | |- |

| |F5 | | |F5 |

| Zeile 32: |

Zeile 37: |

| |- | | |- |

| |F3 | | |F3 |

| |Der Roboter muss Hindernisse umfahren können. | | |Der AlphaBot muss Hindernisse umfahren können. |

| |- | | |- |

| |F4 | | |F4 |

| Zeile 41: |

Zeile 46: |

| {| class="wikitable" | | {| class="wikitable" |

| |NF1 | | |NF1 |

| |Es muss ein Alphabot verwendet werden. | | |Es muss ein AlphaBot verwendet werden. |

| |- | | |- |

| |NF2 | | |NF2 |

| |Der Roboter muss mit dem [[Robot Operating System 2| ROS2]] programmiert werden. | | |Der AlphaBot muss mit ROS2 programmiert werden. |

| |- | | |- |

| |NF3 | | |NF3 |

| |Der Roboter soll mit einem [[Raspberry Pi| Raspberry Pi]] gesteuert werden. | | |Der AlphaBot soll mit einem RPi gesteuert werden. |

| |- | | |- |

| |NF4 | | |NF4 |

| |Der Roboter soll mit Python programmiert werden. | | |Der AlphaBot soll mit Python programmiert werden. |

| |- | | |- |

| |NF5 | | |NF5 |

| |Es soll die Python Bibliothek [[RPi.GPIO python Bibliothek| RPi.GPIO]] verwendet werden. | | |Es soll die Python Bibliothek [https://pypi.org/project/RPi.GPIO/ RPi.GPIO] verwendet werden. |

| |- | | |- |

| |NF6 | | |NF6 |

| Zeile 59: |

Zeile 64: |

| |} | | |} |

|

| |

|

| ===== Hilfreiche Software ===== | | == Übersicht == |

| | === Dokumentation === |

|

| |

|

| # [https://de.wikipedia.org/wiki/Secure_Shell Secure Shell(SSH)]

| |

| # [https://de.wikipedia.org/wiki/PuTTY PuTTY]

| |

|

| |

|

| ==== Raspberry Pi über Secure Shell(SSH) mit Desktop PC verbinden ====

| |

|

| |

|

| In dem hier beschriebenen Projekt wurde [https://de.wikipedia.org/wiki/Secure_Shell Secure Shell(SSH)] zur Verwendung des RPi's verwendet.

| |

| Dies ermöglicht die Nutzung des RPi's und Ubuntu Desktop auf einem Bildschirm gleichzeitig.

| |

| So wird keine HDMI-Verbindung zwischen dem RPi und einem Bildschirm mehr benötigt.

| |

|

| |

|

| Über SSH kann der AlphaBot später mittels einer WIFI-Verbindung autonom fahren.

| | ===== verwendete Hardware ===== |

|

| |

|

| Die SSH Verbindung kann über verschiedene Wege erfolgen. Zum einen über das Programm [https://de.wikipedia.org/wiki/PuTTY PuTTY] oder über das Ubuntu Desktop Terminal.

| | # AlphaBot |

| | # Raspberry Pi 4 |

| | # mciro-SD Karte mit SD-Karten Adapter |

| | # HDMI-Kabel |

| | # Netzwerkkabel |

| | # Netzwerkswitch |

|

| |

|

| Im weiteren wird beschrieben, wie SSH auf dem RPi aktiviert wird und wie es mit PuTTY oder in einem Terminal verwendet werden kann.

| | ===== verwendete Software ===== |

|

| |

|

| ===== SSH auf dem Raspberry Pi Aktivieren =====

| | # Ubuntu Server 20.04 |

| | | # Python |

| [[Datei:SSH_Datei_erstellen.png|right|mini|500px|Abb 2: Ordner mit der SSH-Datei <nowiki></nowiki>]]

| | # ROS2 |

| | | # Secure Shell (SSH) |

| Damit SSH genutzt werden kann muss es auf dem Raspberry Pi zuerst aktiviert werden.

| | # [https://de.wikipedia.org/wiki/PuTTY PuTTY] |

| Dazu sind folgende Schritte wie in Abb. 2 gezeigt zu befolgen:

| |

| | |

| # SD-Karte mit einem SD-Karten-Adapter in ein Kartenleseslot an einem PC stecken | |

| # im boot-Verzeichnis (hier: "system-boot") mit rechter Maustaste Drop-Down-Menu öffnen

| |

| # unter dem Reiter Neu "Textdokument" auswählen

| |

| # ssh als Namen eingeben, zunächst wird die Datei ssh.txt heißen

| |

| # im Windows-Explorer unter dem Reiter Ansicht Haken bei Dateinamenserweiterung setzen, damit die Dateiendung angezeigt wird | |

| # die nun angezeigte .txt Dateiendung entfernen | |

| # die darauf folgende Warnung mit JA bestätigen

| |

| # beim Booten des Raspberry Pi's wird nun SSH aktiviert | |

| | |

| <br clear=all>

| |

| | |

| ===== IP-Adresse des RPi herausfinden =====

| |

| | |

| [[Datei:Log In Bildschirm.jpg|right|mini|250px|Abb 3: Beispiel <nowiki><log in Bildschirm</nowiki>]]

| |

| | |

| Damit der Raspberry Pi über SSH verbunden werden kann, wird die IPv4-Adresse des Raspberry Pi's benötigt.

| |

| | |

| | |

| Dafür wird der RPi mit einem HDMI-Kabel an einem Bildschirm und an das dazugehörige Stromkabel angeschlossen.

| |

| | |

| Allgemein muss der RPi für eine SSH-Verbindung mit dem Internet verbunden sein.

| |

| Hier kann der RPi mit einem Ethernet Kabel oder über einer WIFI-Verbindung verbunden werden.

| |

| Für die Ethernet-Verbindung wird zwischen den RPi und den Computer ein Netzwerk-Switch zwischengeschaltet.

| |

| | |

| Und um den RPi mit WIFI zu verbinden, muss die RPi Netzwerk Konfiguration verändert werden. Wie das gemacht wird kann in dem Artikel zur Installation von Ubuntu Server nachgelesen werden.

| |

| | |

| | |

| Wenn letzteres das Stromkabel angeschlossen wurde, bootet der RPi und der Login Bildschirm wird angezeigt, wo nach dem Benutzernamen (hier: ubuntu) und nach dem Passwort (hier: Hshl2021) gefragt wird(Abb. 3).

| |

| | |

| <br clear=all>

| |

| | |

| Nach der Anmeldung auf dem Raspberry Pi, kann die IPv4-Adresse auf dem Start Bildschirm abgelesen werden.

| |

| | |

| Für den hier verwendeten RPi war die Ethernet IP-Adresse <code> 172.31.14.89</code>, wie in Abb. 4 zusehen ist. Und für WIFI war die IP-Adresse 192.168.10.102.

| |

| | |

| | |

| [[Datei:StartBild_Ubuntu_Server.png|left|mini|300px|Abb 4: Beispiel <nowiki>IP-Adresse</nowiki>]]

| |

| <br clear=all>

| |

| | |

| ===== PuTTY für die SSH Verbindung =====

| |

| | |

| Wie oben erwähnt, kann die freie Software PuTTY zur Herstellung von Secure Shell Verbindungen verwendet werden.

| |

| Auf einem Pc mit Ubuntu wird PuTTY über die Kommandozeile installiert [https://wiki.ubuntuusers.de/PuTTY/].

| |

| | |

| | |

| <code> sudo apt-get install putty </code>

| |

| | |

| [[Datei:PuTTY Konfiguration.png|right|mini|350px|Abb. 5: PuTTY Start Bildschirm]]

| |

| | |

| | |

| | |

| Nach der Installation kann über die folgenden Schritte SSH gestartet werden(Abb. 5):

| |

| | |

| # starten von PuTTY über ein Terminal mit dem Befehl <code> putty </code> | |

| # Reiter Session auswählen

| |

| # bei Host-Name die IP-Adresse des RPi angeben

| |

| # als Connection Type SSH auswählen

| |

| # überprüfen ob Port 22 eingestellt ist

| |

| # gegeben falls spezifischen Namen geben

| |

| # mit save die Ip-Adresse abspeichern

| |

| # auf Open klicken, um SSH zu starten

| |

| | |

| | |

| <br clear=all>

| |

| | |

| Dann öffnet sich ein neues Fenster, wo sich mit den zuvor gezeigten Anmeldedaten(username: ubuntu, Passwort: Hshl2021) auf dem RPi angemeldet werden kann.

| |

| | |

| Nach dem Anmelden sieht der PuTTY-Bildschirm, wie in Abb. 6 gezeigt aus.

| |

| Hier ist außerdem zusehen das die SSH-Verbindung über WIFI hergestellt wurde und die IP-Adresse eine andere ist, wie bei Ethernet.

| |

| | |

| Um die IP-Adressen auseinander zuhalten, ist es am besten, bei der ersten Nutzung des RPi's die IP-Adressen einmal nachzuschauen.

| |

| | |

| [[Datei:Putty_Login.png|left|mini|350px|Abb. 6: PuTTY Login Bildschirm]]

| |

| <br clear=all>

| |

| | |

| Nun ist die SSH-Verbindung über PuTTY hergestellt.

| |

| | |

| ===== SSH über ein Terminal verwenden =====

| |

| Eine SSH-Verbindung über ein Ubuntu Terminal herzustellen ist im Vergleich zu PuTTY einfacher.

| |

| | |

| Dafür muss nur der Befehl <code> ssh username@IP-Adresse </code> [https://wiki.ubuntuusers.de/SSH/] in einem Terminal eingegeben werden.

| |

| Danach erscheint direkt im Terminal der Login-Bildschirm.

| |

| | |

| Hier kann sich wie gewohnt mit den genannten Daten angemeldet werden.

| |

| | |

| ==== Microcontroller coding mit der Integration von ROS2 ====

| |

| | |

| In diesem Abschnitt wird die Programmierung des Raspberry Pi's mit ROS2 beschrieben. Dazu gehört die Motorsteuerung, genau sowie die Infrarot Sensoren oder dem Ultraschallsensor um Hindernisse umfahren zu können.

| |

| | |

| Da es die Bibliothek wiringPi, welche für die Ansteuerung der GPIO Pins über CPP nicht mehr unterstützt wird, haben wir uns für die Python Bibliothek "RPi.GPIO" entschieden.

| |

| | |

| Da es beim ausführen von den Codes auf dem RPi zu dem Fehler "RuntimeError: Not running on a RPi!" kam, können die folgenden Befehle helfen.

| |

| Die hier genannten Befehle müssen bei jedem Neustart des RPi's erneut ausgeführt werden.

| |

| | |

| Die ersten beiden Befehle zeigen, ob gpiomem schon vorhanden ist.

| |

| | |

| <code> ls -l /dev/ gpiomem </code>

| |

| | |

| Ausgabe: <code> crw-rw---- 1 root dialout 239, 0 Apr 1 17:23 /dev/gpiomem </code>

| |

| | |

| <code> groups </code>

| |

| | |

| Ausgabe: <code> ubuntu adm dialout cdrom floppy sudo audio dip video plugdev netdev lxd </code>

| |

| | |

| Um gpiomem dann zu erlauben sind die folgenden zwei Befehle erforderlich.

| |

| | |

| <code> sudo chown root.gpio /dev/gpiomem </code>

| |

| | |

| <code> sudo chmod g+rw /dev/gpiomem </code>

| |

| | |

| Um mit der Programmierung zu beginnen wurde ein Ros2 Workspace mit einem source Ordner erstellt.

| |

| | |

| <code>

| |

| mkdir ros_ws

| |

| | |

| cd ros_ws

| |

| | |

| mkdir src

| |

| </code>

| |

| | |

| In dem source Ordner wurde dann das ROS2 Package mit den benötigten Bibliotheksabhängigkeiten erstellt.

| |

| Dazu gehören rclpy, der ROS2 Client Library für Python und std_msgs, um die Standard Nachrichten, wie Int8, Float64 oder String in ROS2 nutzen zu können.

| |

| <br>

| |

| <code> ros2 pkg create --build-type ament_python packagename(z.B. sensor_test) --dependencies rclpy std_msgs </code>

| |

| | |

| | |

| ===== [[Motorsteuerung | Motorsteuerung ]] =====

| |

| | |

| ===== [[Infrarot Hindernisumfahrung | Infrarot Hindernisumfahrung]] =====

| |

| | |

| [[Datei:Infrared.png|right|mini|500px|Abb. 9 Infrarot Hindernisumfahrung]]

| |

| | |

| Nachdem die Motoren mit ROS2 implementiert und getestet wurden, wurde die Hindernisumfahrung mit Infrarotsensoren implementiert.

| |

| Hierfür wurden zwei neue Dateien mit den Namen "master_IR.py" und "slave_IR.py" in dem source Ordner des ROS2 Packages erstellt.

| |

| | |

| | |

| Der Ablauf für die Hindernisumfahrung mit Infrarotsensoren ist in Abb. 9 abgebildet.

| |

| | |

| | |

| Das Programm wird mit einer ROS2 launch-file ausgeführt. Die launch-file beinhaltet alle auszuführenden ROS2-Nodes. Dazu gehört der package Name und der Name der auszuführenden Datei. Mit dem folgenden Befehl werden dann beide Nodes ausgeführt.

| |

| | |

| <code> ros2 launch sensor_test alphabot_IR_launch.py </code>

| |

| | |

| | |

| Dann fährt der AlphaBot los und die Sensordaten werden über die Slave-Node an die Master-Node gepublished.

| |

| | |

| | |

| Nachdem die Master-Node die Sensordaten erhalten hat, entscheidet sie über eine IF-Schleife in welche Richtung der AlphaBot fahren kann.

| |

| | |

| | |

| Der unterschied zur Motorsteuerung oben ist, das hier der Master anhand der Sensordaten forward, right, left oder backward an die Slave-Node published.

| |

| | |

| | |

| Für die Sensordaten musste zunächst der richtige Datentype herausgefunden werden. Dazu kann dieser Code in der Slave-Node unter der timer_callback() Funktion nachdem DR_status deklariert wurde integriert werden.

| |

| | |

| <code>

| |

| print(type(DR_status))

| |

| </code>

| |

| | |

| So wurde herausgefunden, dass es sich hier um ein Integer handelt.

| |

| Mit der Codezeile <code> print(DR_status) </code> wurde festgestellt, dass diese Infrarotsensoren bei einer <code>1</code> nichts vor ihnen steht und bei einer <code>0</code> etwas im Weg ist.

| |

| | |

| So published die Master-Node "forward" wenn die Slave-Node für beide Sensoren eine 1 published und steuert beide GPIO Pins zum vorwärts fahren an.

| |

| Wenn z.B. der rechte Sensor eine "0" und der linke eine "1" angibt, dann ist rechts ein Hindernis. Der master sendet der Slave die Nachricht "left", sodass die Slave-Node die GPIO Pins zum rückwärts fahren des Linken Motors ansteuert.

| |

| | |

| | |

| In dem folgenden Sequenzdiagramm ist die Kommunikation zwischen Master und Slave deutlicher zu erkennen(Abb. 10).

| |

| | |

| So ist in der Abbildung zu sehen, das zunächst die Slave die Sensordaten abfragt und über timer_callback() an den Master published.

| |

| | |

| Anschließend published der Master anhand der erhaltenden Sensordaten ein Movement an die Slave. Die Slave steuert dann die Motoren an.

| |

| [[Datei:Infrared_Sequenzdigramm.png|left|mini|600px|Abb. 10 Infrarot Hindernisumfahrung Sequenzdiagramm]]

| |

| | |

| <br clear=all>

| |

| | |

| In Abb. 11 ist zu der Infrarot Hindernisumfahrung ein Beispiel, wie das in einem Terminal während der Programmausführung aussieht.

| |

| | |

| So fährt der AlphaBot vorwärts (I heard: "forward"), da für beide IR-Sensoren eine 1 ausgelesen wurde.

| |

| | |

| Oder er fährt links (I heard: "left"), da für den rechten IR-Sensor eine 0 und für den linken eine 1 ausgelesen wurde.

| |

| | |

| [[Datei:IR_Left.jpg|left|mini|500px|Abb. 11 Hindernisumfahrung Beispiel]]

| |

| | |

| <br clear=all>

| |

| | |

| In ROS2 können die Programmierten Nodes und Topics in einem RQT-Graph grafisch Dargestellt werden wie schon in den ROS2 Tutorials gezeigt.

| |

| Für die Infrarot Hindernisumfahrung könnte der Graph dann wie in Abb. 12 gezeigt aussehen.

| |

| | |

| Dort ist zusehen das der master zu den beiden Topics "IR_right und IR_left" subscript und über die Topic "cmd_vel" published. Auf der anderen Seite, die Slave, published über die Topics "IR_right und IR_left" und subscript zur Topic "cmd_vel".

| |

| | |

| [[Datei:RQT_Graph_Infrared.jpeg|left|mini|600px|Abb. 12 Infrarot Hindernisumfahrung]]

| |

| | |

| <br clear=all>

| |

| | |

| Zudem gibt es unter RQT die Möglichkeit die Sensordaten in einem sogenannten Plot darzustellen.

| |

| | |

| Dazu muss in RQT unter dem Reiter Plugin, Visualisierung Plot ausgewählt werden, wie in Abb. 13 gezeigt.

| |

| | |

| [[Datei:RQT_Plot_öffnen.png|left|mini|300px|Abb. 13 RQT Plot öffnen]]

| |

| | |

| <br clear=all>

| |

| | |

| In dem Plot kann das Koordinatensystem mit dem in Abb. 14 markierten Bereich in der Größe eingestellt werden.

| |

| | |

| An der X-Axis muss nichts geändert werden, da diese sich während der Ausführung automatisch erweitert. Unter Y-Axis lässt sich für Bottom der niedrigste Wert und für Top der höchste Wert, welches das Koordinaten System haben soll einstellen.

| |

| | |

| [[Datei: Koordinatensystem einstellen.png|left|mini|300px|Abb. 14 Koordinatensystem einstellen]]

| |

| | |

| <br clear=all>

| |

| | |

| Um die Sensordaten dem Plot hinzuzufügen wird der Topic-Monitor benötigt. Der Topic Monitor wird über den Reiter Plugin und dann Topics, Topic Monitor geöffnet.

| |

| | |

| In Abb. 15 sind links über den Topic Monitor die verschiedenen Topics zu sehen. Über den Pfeil links neben den Topics wird ein weiterer Reiter Namens "data" ausgeklappt(Abb. 15 1.)

| |

| Unter den Topics DR_left und DR_right kann "data" per drag and drop in den Plot gezogen werden. So erscheint in dem Plot oben links eine Legende mit dem Topic Namen und der Farbe des Graphens(Abb. 15 2.). Während der Laufzeit wird dann der Plot für die beiden IR-Sensoren generiert.

| |

|

| |

| Außerdem ist zusehen, das zweimal der blaue Graph auf 0 fällt.

| |

| So ist hier genauer zu erkennen, dass sich die Sensordaten nur auf 1 und 0 beschränken.

| |

| Weiter ist zuerkennen, dass der linke Sensor(blauer Plot) anspricht und dort sich zu dem Zeitpunkt ein Hindernis befindet.

| |

| | |

| [[Datei:RQT_Plot_Infrared.png|left|mini|600px|Abb. 16 Infrarot Hindernisumfahrung]]

| |

| | |

| <br clear=all>

| |

| | |

| | |

| [[Kommunikation Raspberry Pi mit ROS2|Kommunikation Raspberry Pi mit ROS2]]

| |

| | |

| ===== Ultraschall Hindernisumfahrung =====

| |

| | |

| Zuletzt wurde die Hindernisumfahrung mit dem Ultraschallsensor implementiert.

| |

| Die Motoren werden wie bei den anderen Programmen angesteuert. Der Code wird mit einem Servomotor, um den Ultraschallsensor nach rechts und links zu drehen, erweitert und die Infrarotsensoren werden durch den Ultraschallsensor ersetzt.

| |

| | |

| Dazu wurden die beiden Dateien slave_Sonar.py und master_Sonar.py erstellt.

| |

| | |

| [[Datei:Ultraschall_Activity.png|right|mini|500px|Abb. 17 Ultraschall Hindernisumfahrung]]

| |

| | |

| Bei der Implementierung lag zunächst die Schwierigkeit, dass die Master-Node die Sensordaten nicht zum richtigen Zeitpunkt erhalten hat. So wurden zum Beispiel die Sensordaten für rechts und links gepublished, sind aber erst im zweiten durchlauf der Master-Node bei dem subscriber angekommen.

| |

| | |

| Der funktionierende Code kann in dem SVN-Repository unten in diesem Artikel unter '''Demo''' nachgeschlagen werden.

| |

| | |

| Der Ablauf für die Hindernisumfahrung mit Ultraschallsensor ist in Abb. 17 dargestellt.

| |

| | |

| Hier wurde wie bei der Infrarot-Hindernisumfahrung eine Launch-file erstellt, welche zunächst gestartet wurden muss.

| |

| | |

| <code> ros2 launch sensor_test alphabot_Sonar_launch.py </code>

| |

| | |

| Wenn die launch-file ausgeführt wurde, fährt der AlphaBot los und die Slave-Node published die Sensordaten über die Topic Sonar/middle an die Master-Node.

| |

| | |

| Anhand dieser Daten überprüft die Master-Node über eine if-Schleife, ob die Entfernung kleiner 50 ist. Solange der Wert über 50 ist, wird die Nachricht "forward" gepublished und der AlphaBot fährt geradeaus.

| |

| | |

| Wenn die Entfernung kleiner 50 wird, hält die Slave-Node bei erhalt der Nachricht "stop" von der Master-Node, den AlphaBot an.

| |

| Weiter published die Master-Node die Nachricht "lookRight". Wenn die Slave-Node diese Nachricht erhält, steuert sie die GPIO Pins für den Servomotor an, um den Sensor nach rechts zu drehen. Das funktioniert mit dem sogenannten DutyCycle.

| |

| | |

| <code> self.p.ChangeDutyCycle(2.5) </code>

| |

| | |

| Dann published die Master-Node "rightData" und nachdem die Slave-Node das erhalten hat, published sie die Sensordaten über die Topic "Sonar/right".

| |

| | |

| Mit dem gleichen Prinzip wird der Sensor als nächstes nach links gedreht. Das passiert über die Nachrichten "lookLeft" und "leftData".

| |

| | |

| Zuletzt wird der Ultraschallsensor mit der Nachricht "lookForward" und dem entsprechendem DutyCylce 7.5 zur Ausgangsposition zurückgedreht.

| |

| | |

| Die Master-Node wertet die Daten über eine weitere if-Schleife aus und published die Nachricht, in welche Richtung der AlphaBot fahren kann.

| |

| | |

| So wird "backward" gepublished, wenn links und rechts der Wert kleiner 50 ist, oder "right", wenn der rechte Wert größer ist wie der linke Wert. Und ansonsten wird "left" gepublished.

| |

| | |

| Die Slave-Node steuert anhand der erhaltenden Nachricht die GPIO Pins an, um das Hindernis zu umfahren.

| |

| | |

| <br clear=all>

| |

| | |

| In dem hier gezeigten Sequenzdiagramm wird die Kommunikation zwischen Master und Slave aufgezeigt(Abb.18).

| |

| | |

| So ist zusehen, wann die Slave Sensordaten an den Master published und wann der Master Movements an die Slave published.

| |

| | |

| | |

| [[Datei:Ultraschall_Sequenzdiagramm.png|left|mini|500px|Abb. 18 Ultraschall Hindernisumfahrung Sequenzdiagramm]]

| |

| | |

| <br clear=all>

| |

| | |

| Die Terminalausgabe während das Programm ausgeführt wird, könnte wie in Abb. 19 aussehen.

| |

| | |

| Dort ist zu erkenne, dass nur middle_data gepublished wird bis dieser Wert unter 50 fällt.

| |

| | |

| Dann werden zusätzlich die Sensordaten für links und rechts gepublished, nachdem der Servo nach rechts und links gedreht wurde.

| |

| | |

| [[Datei:Ultraschall_Example.jpg|left|mini|500px|Abb. 19 Ultraschall Hindernisumfahrung]]

| |

| <br clear=all>

| |

| | |

| In dem RQT-Graph zur Ultraschall Hindernisumfahrung wurden die Sensordaten Topics zu einer Gruppe zusammengefasst, da nur ein Ultraschallsensor mit 3 ROS2 Topics verwendet wurde(Abb. 20).

| |

| | |

| Das wurde gemacht, um die Sensordaten für links, Mitte und rechts auseinander zuhalten.

| |

| | |

| Allgemein ist das Prinzip, wie bei der Infrarot Hindernisumfahrung, nur das die Slave über drei verschiedene Topics die Sensordaten published.

| |

| | |

| Und über die cmd_vel Topic werden zusätzlich die Servo-Movements gepublished.

| |

| | |

| [[Datei:Ultraschall_RQT_Graph.jpg|left|mini|500px|Abb. 20 Ultraschall RQT-Graph]]

| |

| <br clear=all>

| |

| | |

| === Demo ===

| |

| | |

| Checkout URL : https://svn.hshl.de/svn/Robotik_und_Autonome-Systeme/trunk/Projekte/AlphaBot_PI_ROS2/

| |

| | |

| Der Code kann direkt aus dem SVN-Verzeichnis ausgeführt werden.

| |

| | |

| {| class="wikitable"

| |

| |-

| |

| ! # !! Name

| |

| |-

| |

| | 1 || Motortest

| |

| |-

| |

| | 2 || Infrared_Obstacle_Avoidance

| |

| |-

| |

| | 3 || Ultrasonic_Obstacle_Avoidance

| |

| |}

| |

| | |

| Schritt für Schritt Anleitung unter Ubuntu um den Code auszuführen:

| |

| | |

| #ein neues Terminal öffnen

| |

| #zum Verzeichnis des Packages gehen <code> cd svn/Projekte/AlphaBot_PI_ROS2 </code>

| |

| #<code> colcon build </code> beziehungsweise <code> colcon build --packages-select sensor_test </code> zum kompilieren des ROS2 Codes ausführen

| |

| #<code> . install/setup.bash </code>

| |

| | |

| 1. Motortest:

| |

| | |

| #<code> ros2 run sensor_test Motortest </code> im Terminal ausführen

| |

| #Manuelle Nachricht publishen <code> ros2 topic pub /cmd_vel std_msgs/msg/String '{data: forward}' </code>

| |

| #durch STRG C das publishen der Nachricht stoppen

| |

|

| |

|

| 2. Infrared_Obstacle_Avoidance:

| | ==== [[ Raspberry Pi über Secure Shell(SSH) mit Desktop PC verbinden | Raspberry Pi über Secure Shell(SSH) mit Desktop PC verbinden]] ==== |

|

| |

|

| #<code> ros2 launch sensor_test alphabot_IR_launch.py </code> im Terminal ausführen

| | ==== [[ Programmierung / Funktionsweise der ROS2 Codes | Programmierung / Funktionsweise der ROS2 Codes ]] ==== |

| #AlpaBot fährt autonom und umfährt Hindernisse mit Infrarotsensoren

| |

|

| |

|

| 3. Ultrasonic_Obstacle_Avoidance:

| | ==== [[ Darstellung der Ergebnisse | Darstellung der Ergebnisse ]] ==== |

|

| |

|

| #<code> ros2 launch sensor_test alphabot_Sonar_launch.py </code> im Terminal ausführen

| | ==== [[ Demo | Demo]] ==== |

| #AlpaBot fährt autonom und umfährt Hindernisse mit Ultraschallsensor

| |

|

| |

|

| == [[Zusammenfassung_Praxissemester_Gerken|Zusammenfassung]] == | | == [[Zusammenfassung_Praxissemester_Gerken|Zusammenfassung]] == |

| Zeile 426: |

Zeile 101: |

|

| |

|

| * [https://wiki.ubuntuusers.de/PuTTY/ PuTTY Installation] | | * [https://wiki.ubuntuusers.de/PuTTY/ PuTTY Installation] |

| | * [https://wiki.ubuntuusers.de/SSH/ SSH ] |

|

| |

|

|

| |

|

| ---- | | ---- |

| → zurück zum Hauptartikel: [[Robot_Operating_System_2|Robot Operating System2 (ROS2)]] | | → zurück zum Hauptartikel: [[Robot_Operating_System_2|Robot Operating System2 (ROS2)]] |